Durante los últimos cuarenta años, el paradigma fundamental de la informática no ha cambiado: el humano piensa, el humano mira la pantalla, el humano mueve el ratón y el humano hace clic. Nosotros somos el motor de ejecución. El ordenador, por muy potente que sea, espera pasivamente nuestras instrucciones, clic a clic, ventana a ventana.

Incluso con la llegada de ChatGPT y la revolución generativa de 2023-2025, la dinámica seguía siendo la misma. La IA nos daba la «receta» (un texto, un código, un resumen), pero nosotros teníamos que «cocinarla» (copiar el texto, pegarlo en un correo, abrir el programa de diseño, exportar el archivo). Seguíamos siendo el «middleware» humano que conecta aplicaciones que no se hablan entre sí.

Hoy, 20 de febrero de 2026, Google DeepMind ha decidido que esa era ha terminado.

En una demostración que ha dejado a la industria conteniendo el aliento, el gigante de Mountain View ha presentado su «Agente Universal» (Universal Computer-Using Agent). No es un chatbot más inteligente. Es un cambio radical en la relación humano-máquina: una IA diseñada para sentarse en tu silla virtual, mirar tu pantalla con sus propios ojos digitales y usar tu ratón y teclado para hacer el trabajo sucio por ti.

La IA que «ve» lo que tú ves

¿Qué hace diferente a este Agente Universal de los asistentes que conocíamos hasta ayer? La clave está en la multimodalidad visual.

Hasta ahora, para que una IA interactuara con un software, necesitaba una API (un enchufe trasero para programadores). Si una aplicación era antigua o no tenía API, la IA era inútil.

El nuevo modelo de DeepMind, integrado experimentalmente en ChromeOS y Windows 11, no necesita APIs. Funciona como un humano: interpreta píxeles. Utiliza modelos de visión por computador avanzadísimos para «ver» la pantalla en tiempo real. Identifica qué es un botón de «Aceptar», qué es un campo de texto para introducir una fecha, dónde está el icono de Excel o cómo cerrar una ventana emergente de publicidad.

Entiende la interfaz gráfica (GUI) independientemente de cómo esté programada por debajo. Y, lo más importante, tiene permiso para controlar el cursor y el teclado virtualmente para interactuar con esos elementos.

El fin de la «Tasa de la Interfaz»

La promesa de Google es eliminar lo que los expertos llaman la «tasa de la interfaz»: el tiempo y la energía cognitiva que desperdiciamos navegando por menús, recordando dónde estaba aquella opción o transfiriendo datos de una ventana a otra.

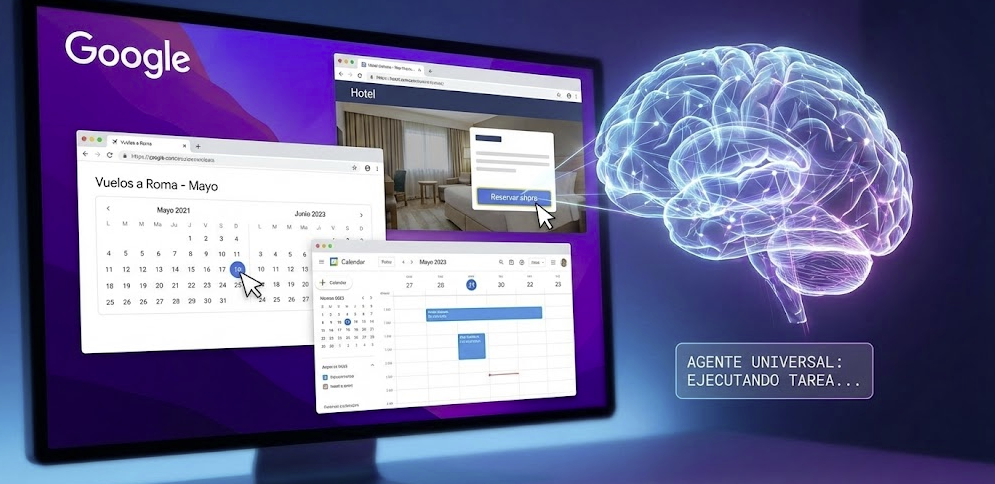

En la demo de hoy, Google mostró un ejemplo que resume perfectamente este cambio de paradigma. Un usuario le dijo al agente por voz:

«Organízame un viaje a Roma para el segundo fin de semana de mayo. Busca vuelos baratos que salgan el viernes por la tarde, un hotel céntrico de al menos 3 estrellas, y cuando lo tengas, bloquéame las fechas en el calendario y mándale un resumen por correo a mi pareja».

Lo que sucedió a continuación fue fascinante. El humano soltó el ratón. El cursor cobró vida propia.

La IA abrió el navegador, navegó a un comparador de vuelos, seleccionó las fechas (entendiendo qué días eran el «segundo fin de semana de mayo»), filtró los resultados y eligió una opción. Luego, saltó a una pestaña nueva con Booking.com, buscó hoteles en Roma, aplicó los filtros de «céntrico» y «3 estrellas», y cruzó la disponibilidad con los vuelos. Finalmente, abrió Google Calendar, creó el evento, y terminó redactando un email en Gmail con los enlaces y precios, dejándolo listo para enviar.

Todo ello en menos de dos minutos, atravesando tres webs y dos aplicaciones de escritorio distintas, sin una sola intervención humana.

De dar instrucciones a delegar responsabilidades

Este avance marca el paso definitivo de una IA «instructiva» a una IA «ejecutiva».

Durante los últimos años nos hemos maravillado con la capacidad de la IA para generar contenido. Pero el verdadero cuello de botella de la productividad moderna no es la falta de ideas, sino la fricción de la ejecución.

El «Agente Universal» plantea un futuro cercano donde la interfaz de usuario pasa a ser irrelevante para el humano. Ya no necesitarás aprender dónde ha escondido Microsoft la opción de «Combinar correspondencia» en Word, ni pelearte con el pésimo diseño de la web de la administración pública para renovar un certificado. Si se puede ver en la pantalla, el agente puede manejarlo.

El reto de la confianza

Por supuesto, entregar el control de nuestro ratón y teclado a una inteligencia artificial plantea desafíos de seguridad y confianza monumentales. ¿Qué pasa si el agente se equivoca y compra un billete de 5.000 euros en lugar de uno de 500? ¿Qué pasa si, navegando por mis archivos para buscar una foto, abre accidentalmente un documento confidencial?

Google ha asegurado que el sistema opera en un «sandbox» (entorno seguro) con límites estrictos, y que acciones críticas —como el pago final con tarjeta de crédito o el borrado de archivos— requieren siempre una confirmación biométrica del usuario humano.

La tecnología aún está en fase de despliegue limitado, pero el mensaje de este viernes de febrero de 2026 es claro: en el futuro, usar un ordenador no significará saber dónde hacer clic, sino saber qué pedir. El ratón, ese fiel compañero desde los años 80, acaba de recibir su preaviso de jubilación.